Sieci szerokopasmowe

dodano: 06-06-2013

- 1. Dlaczego światłowód?

- 2. Usługi – czyli na co tak duże pasmo

- 3. Podział sieci

- 4. Topologie fizyczne sieci

- 5. Techniki komunikacyjne

- 6. Rozkład ruchu w internecie

- 7. Dostęp do internetu w Polsce

- 8. Medium transmisyjne

- 9. Techniki dostępu do sieci i operatorzy

Obecnie najbardziej rozpowszechnioną techniką dostępową są systemy xDSL (ADSL i VDSL) na łączach miedzianych, bazujące na architekturze punkt–punkt. W najszybszej wersji (VDSL) są one teoretycznie w stanie zapewnić pasmo 52 Mb/s każdemu użytkownikowi. Techniki xDSL są jednak technikami ograniczonymi szumowo, ma to niebagatelny wpływ na długość łącza. Na przykład dopuszczalna odległość do abonenta dla maksymalnej teoretycznej przepustowości to 300 metrów.

Obecnie najbardziej rozpowszechnioną techniką dostępową są systemy xDSL (ADSL i VDSL) na łączach miedzianych, bazujące na architekturze punkt–punkt. W najszybszej wersji (VDSL) są one teoretycznie w stanie zapewnić pasmo 52 Mb/s każdemu użytkownikowi. Techniki xDSL są jednak technikami ograniczonymi szumowo, ma to niebagatelny wpływ na długość łącza. Na przykład dopuszczalna odległość do abonenta dla maksymalnej teoretycznej przepustowości to 300 metrów.

Biorąc pod uwagę fakt, że wymaganym pasmem do zapewnienia usług szerokopasmowych (telewizja wysokiej rozdzielczości, internet i telefonia) już niebawem będzie 30 Mb/s, maksymalny zasięg takiej sieci to około 900 m. Mimo iż nowoczesne usługi szerokopasmowe przesyłane po kablu miedzianym techniką xDSL pozwalają na zapewnienie abonentowi potrójnej usługi: telewizji, Internetu i telefonii (ang. triple-play), to ograniczenia związane z odległością, limitowaną szerokością pasma i podatnością kabli miedzianych na szumy sprawiły, że techniki xDSL można uznać za tymczasowe i ograniczające rozwój nowych usług. Już w tym momencie brakuje pasma na dodatkowe usługi lub lepszą jakość przesyłanego obrazu telewizyjnego. Warto podkreślić, że obecne HDTV wymagające pasma około 12 Mb/s to dopiero początek nowej jakości w telewizji i planowane są już kolejne standardy:

Standard TV – 2 Mb/s

HDTV – 12 Mb/s

HDTV Super – 50 Mb/s (Wg Specyfikacji ITU J601)

HDTV Ultra – 200 Mb/s (Wg Specyfikacji ITU J601)

3D HDTV – ponad 280 Mb/s

Szacunkowe analizy pasma wymaganego przez pakiet triple play z telewizją wysokiej rozdzielczości wskazują na konieczność dostarczenia w najbliższej przyszłości każdemu abonentowi pasma rzędu 30–50 Mb/s, a w kolejnych latach nawet 100 Mb/s. Już na pierwszy rzut oka widać, że wymagania te są zbyt wygórowane dla eksploatowanych dzisiaj sieci dostępowych (miedzianych), w związku z czym należy szukać nowych technik umożliwiających dostarczenie wymaganego pasma.

Jeśli nie miedź to co?

Rozwiązaniem problemu braku pasma w sieci dostępowej jest… światło. Dokładniej rzecz ujmując, mówimy o zrezygnowaniu z kabli miedzianych i budowie sieci w technice światłowodowej FTTx (gdzie „x” oznacza punkt zakończeniowy włókna światłowodowego w bezpośredniej bliskości odbiorcy końcowego). Zapewnia ona nie tylko odpowiednią pojemność informacyjną dla dostarczenia usług oferowanych dzisiaj, lecz również dla przyszłych potrzeb. Dodatkowo, sieć FTTx zbudowana jest w większości z urządzeń pasywnych, dlatego koszt eksploatacji takich łącz jest wielokrotnie niższy niż tych, opartych na kablach miedzianych.

Rozwiązaniem problemu braku pasma w sieci dostępowej jest… światło. Dokładniej rzecz ujmując, mówimy o zrezygnowaniu z kabli miedzianych i budowie sieci w technice światłowodowej FTTx (gdzie „x” oznacza punkt zakończeniowy włókna światłowodowego w bezpośredniej bliskości odbiorcy końcowego). Zapewnia ona nie tylko odpowiednią pojemność informacyjną dla dostarczenia usług oferowanych dzisiaj, lecz również dla przyszłych potrzeb. Dodatkowo, sieć FTTx zbudowana jest w większości z urządzeń pasywnych, dlatego koszt eksploatacji takich łącz jest wielokrotnie niższy niż tych, opartych na kablach miedzianych.

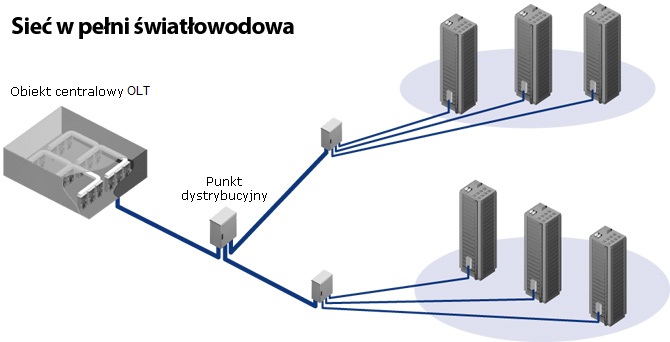

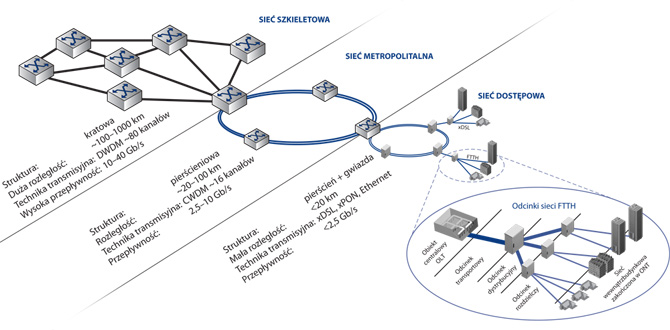

Telekomunikacja optyczna, o ile w ogóle, kojarzy nam się jedynie z dalekosiężnymi sieciami szkieletowymi. Wraz z rozwojem systemów światłowodowych oraz technologii wytwarzania elementów infrastruktury optycznej nastąpiła znaczna poprawa wykorzystania światłowodów, co objawiało się coraz niższym jednostkowym kosztem transmisji danych. W konsekwencji światłowody sukcesywnie wprowadza się do obszaru sieci metropolitalnych, aby w kolejnych latach rozpocząć budowę sieci światłowodowych w obszarze dostępowym, gdzie jeszcze do niedawno królowała miedź – najpierw w postaci pętli lokalnych FITL, a ostatecznie jako kompletne systemy FTTx oparte tylko i wyłącznie na światłowodach. Przykład takiej sieci na schemacie poniżej:

2. Usługi – czyli na co tak duże pasmo

Wzrost potrzeb i świadomości użytkowników sieci napędza rynek nowych aplikacji i usług, co z kolei zwiększa zapotrzebowanie na szerokopasmowy dostęp do internetu. Niejednokrotnie to dostawcy usług (operatorzy), producenci elektronicznego sprzętu (odbiorniki HDTV, konsole do gier, komputery) a także twórcy filmów i gier kreują popyt na rynku konsumenta indywidualnego, przedstawiając mu coraz nowsze media i korzyści z nich płynące. Tym sposobem wraz z gwałtownym wzrostem wydajności sprzętu rośnie zapotrzebowanie na pasmo, za pomocą którego te usługi mają być dostarczane.

Załóżmy więc, że pasmo nie jest dla nas ograniczeniem. Jakie więc usługi już są dostępne, a jakie można wprowadzić w przyszłości:

1. Internet

Internet to sieć komputerowa, bez punktu (serwera) centralnego, która może funkcjonować nawet pomimo uszkodzenia pewnej jej części. Jest to logiczne połączenie komputerów i urządzeń telekomunikacyjnych w jednolitą sieć adresową opartą o protokół IP.

Internet to sieć komputerowa, bez punktu (serwera) centralnego, która może funkcjonować nawet pomimo uszkodzenia pewnej jej części. Jest to logiczne połączenie komputerów i urządzeń telekomunikacyjnych w jednolitą sieć adresową opartą o protokół IP.

Na początek definicja słownikowa internetu, a czym dla nas jest internet na co dzień?

Dla niektórych to niezbędne narzędzie do pracy, dla innych centrum rozrywki a jeszcze inni są po prostu od niego uzależnieni. Używamy go głównie do:

- przeglądania strona internetowych i oglądania filmów,

- kupowania produktów w sklepach internetowych, które mają nierzadko dużo niższe ceny niż sklepy stacjonarne,

- sprawdzania poczty elektronicznej (email),

- rozmów przez komunikator internetowy.

2. Telewizja

Standard TV – 2 Mb/s

Standard TV – 2 Mb/s

HDTV – 12 Mb/s

HDTV Super – 50 Mb/s (Wg Specyfikacji ITU J601)

HDTV Ultra – 200 Mb/s (Wg Specyfikacji ITU J601)

3D HDTV – ponad 280 Mb/s

Telewizja wysokiej rozdzielczości coraz częściej gości w naszych domach, wypierając standardową telewizję, a to dopiero początek! Nie chodzi tu jednak tylko o poprawianie jakości obrazu, projekcje 3D, ale również o interaktywność. W internecie już teraz można znaleźć krótkie interaktywne filmiki, których możemy być reżyserami wybierając zakończenie danej sceny. Wyobraźmy sobie sytuację, gdy oglądając nasz ulubiony film, będziemy mogli w kluczowych momentach zmieniać bieg akcji…

3. VoD i inne usługi na żądanie

Usługi na żądanie to usługi świadczone przez operatorów, które użytkownik może odbierać na własne życzenie, w dowolnie wybranym przez siebie momencie. Najbardziej rozpowszechnioną usługą jest tzw. telewizja na żądanie, czyli coś w rodzaju wirtualnej wypożyczalni filmów.

Jednak usługi na żądanie to nie tylko telewizja. Już teraz, z myślą o dużych korporacjach, oferowane są usługi, gdzie operator może uruchomić zapasowe lub dodatkowe pasmo, lub zwiększyć moc obliczeniową sprzętu, dostępną w każdej chwili na wypadek nagłego i chwilowego zwiększenia popytu ze strony klientów.

4. Gry on-line

Przykładami gier on-line są:

Przykładami gier on-line są:

- małe interaktywne gry,

- gry planszowe i karciane umożliwiającymi rywalizację z innymi graczami,

- gry komputerowe w trybie multiplayer.

5. Gry i programy działające „w chmurze”

Przy okazji gier on-line warto wspomnieć o nowym rozwiązaniu – Gra na żądanie.

Na czym to polega? Gra tak naprawdę uruchamiana jest na jednym z serwerów o bardzo wysokich parametrach, do którego wysyłane są jedynie sygnały z klawiatury i myszki gracza. Wyrenderowany strumień danych (obraz i dźwięk) przesyłane są do odbiorcy przez internet w czasie rzeczywistym. Według firmy OnLive łącze 5 Mb/s jest wystarczające do streamingu gry z szybkością odświeżania 60 fps w rozdzielczości HD, przy opóźnieniu mniejszym niż 80 ms. Dzięki tak niskiemu opóźnieniu nie występują zakłócenia ani przestoje w działaniu gry. W praktyce oznacza to, że bez drogiego sprzętu będziemy mogli zagrać w najnowsze i najbardziej wymagające gry.

Cena? Korzystanie z platformy będzie kosztować około 15 dolarów miesięcznie (wersja podstawowa) + koszta nabycia lub wypożyczenia konkretnej gry, o ile nie mamy jej zakupionej. Termin uruchomienia usługi – czerwiec 2010.

Programy działające w chmurze działają na tej samej zasadzie co gry – nie potrzebują wymagającego sprzętu. Kolejnym rozwiązaniem (już stosowanym) są programy antywirusowe. Na komputerze użytkownika jest instalowana jedynie usługa, która stale łączy się z głównym serwerm sprawdzając i zabezpieczając komputer przed wirusami i atakami. Mamy dzięki temu pewność, że definicje wirusów są aktualne i niezmodyfikowane.

6. VoIP – Telefonia internetowa

To technika przesyłania mowy w postaci sygnału cyfrowego za pomocą sieci opartych o protokół IP, dzięki czemu w dużo lepszym stopniu wykorzystuje się pasmo w porównaniu do tradycyjnej sieci telefonicznej. Kolejnym argumentem za stosowaniem telefonii VoIP jest dużo niższy koszt połączeń. Jednak każdy kij ma dwa końce i ze względu na to, że w sieciach IP informacje przesyłane są w postaci pakietów, mogą one dotrzeć do adresata różnymi ścieżkami. Wiąże się z tym zmienne opóźnienie – przez co, czasem gorsza jakość połączenia.

7. Monitoring oparty o kamery IP

Zarówno w domach jak i firmach w monitoringu stosowane są głównie przemysłowe kamery CCTV, z których obraz może być oglądany zarówno na ekranie podłączonym do tego urządzenia jak i przez Internet. Lepszym rRozwiązaniem są kamery IP, które zdobywają coraz większą popularność. Największą zaletą takich kamer jest możliwość podglądu z każdego miejsca na świecie oraz ich jakość.

Zarówno w domach jak i firmach w monitoringu stosowane są głównie przemysłowe kamery CCTV, z których obraz może być oglądany zarówno na ekranie podłączonym do tego urządzenia jak i przez Internet. Lepszym rRozwiązaniem są kamery IP, które zdobywają coraz większą popularność. Największą zaletą takich kamer jest możliwość podglądu z każdego miejsca na świecie oraz ich jakość.

8. Usługi live traffic

Jest to system badający i przewidujący ruch na drodze. W dużych miastach, obok (a czasem w) jezdni instalowane są czujniki badające natężenie ruchu i na ich podstawie generowane są mapki ulic z zaznaczonymi zakorkowanymi miejscami. Na podstawie danych z kilku tygodni/miesięcy można generować mapki z prognozami na następne godziny.

W Polsce podobną usługę wprowadziło Targeo jednak bazuje ono, nie na systemie czujników, a analizie obrazu z kamer oraz danych od użytkowników korzystających z tej usługi.

9. Wirtualne biuro

Na dojazdy do i z pracy niejednokrotnie tracimy dziesiątki godzin miesięcznie (nie wspominając o kosztach). Rozwiązaniem, które ciężko sobie na razie wyobrazić jest Wirtualne biuro lub praca zdalna. Niektóre profesje nie wymagają fizycznej obecności w biurze, więc wyobraźmy sobie, że mamy dostęp do internetu o niemalże nieograniczonej szybkości.

Na dojazdy do i z pracy niejednokrotnie tracimy dziesiątki godzin miesięcznie (nie wspominając o kosztach). Rozwiązaniem, które ciężko sobie na razie wyobrazić jest Wirtualne biuro lub praca zdalna. Niektóre profesje nie wymagają fizycznej obecności w biurze, więc wyobraźmy sobie, że mamy dostęp do internetu o niemalże nieograniczonej szybkości.

Z każdym pracownikiem możemy się połączyć za pomocą telekonferencji. Dostęp do materiałów (zasobów) na serwerze firmy jest tak samo szybki jak byśmy byli tam fizycznie. Niemożliwe?

10. E-learning

Systemy e-learningowe zdobywają coraz większą popularność, ponieważ umożliwiają naukę zdalną (na odległość) poprzez:

- telekonferencje z rzeczywistym nauczycielem,

- interaktywny system nauki, powtórek i ćwiczeń wykonywanych przez ucznia, online, sprawdzany przez system w sposób automatyczny. System taki umożliwia indywidualny wybór godzin, formę i tempo kształcenia (personalizacja), co jest szczególnie istotne dla osób pracujących.

Kursy e-learningowe to nie tylko oszczędność ekonomiczna ale również możliwość udziału w szkoleniach większej grupy pracowników w taki sposób, aby nie dezorganizować pracy.

11. Zdalna opieka i konsultacje z lekarzem

Jest to pakiet usług świadczonych zdalnie:

• e-recepta – pozwala na zdalne pozyskiwanie recept na leki stosowane przez pacjenta w sposób ciągły.

• e-kartoteka – pozwala przeglądać i pobierać historyczne dane medyczne z kartoteki pacjenta.

• e-monitoring – pozwala pacjentom prowadzić normalny tryb życia, pozbawiając ich stresu związanego z pobytem w szpitalu, przy jednoczesnym monitorowaniu pracy wybranych narządów (tele-EKG, tele-EEG itp.).

• e-konsulting – pozwala otrzymać poradę lekarską przy użyciu dowolnego urządzenia mobilnego, podczas gdy e-diagnozy umożliwiają uzyskanie szybkiej diagnozy na podstawie danych wejściowych.

• Bazy informacji, pozwalające w szybki sposób dotrzeć do podstawowych wskazówek związanych z pierwszą doraźną pomocą w razie wypadków.

Dzięki tym usługom nie będziemy tracić czasu na stanie w kolejkach do lekarza. Nie bez znaczenia pozostaje również aspekt psychologiczny, gdyż w przypadku usług bazujących na osobistych terminalach monitorujących, pacjent znajduje się cały czas „pod opieką” lekarza, co niewątpliwie zwiększa jego komfort psychiczny.

12. Backup online

Kopia bezpieczeństwa, to dane które służą do odtworzenia oryginalnych danych na wypadek ich utraty lub uszkodzenia. Najczęściej jest wykonywana na platformach serwerowych, gdzie regularne i automatyczne tworzenie kopii zapasowych jest podstawową usługą dostarczaną klientowi i chroni go przed utratą danych.

Kopia bezpieczeństwa, to dane które służą do odtworzenia oryginalnych danych na wypadek ich utraty lub uszkodzenia. Najczęściej jest wykonywana na platformach serwerowych, gdzie regularne i automatyczne tworzenie kopii zapasowych jest podstawową usługą dostarczaną klientowi i chroni go przed utratą danych.

Kopie zapasowe można wykonywać samemu za pomocą specjalnego oprogramowania, które umieści je na podanych przez nas nośnikach (dyskach twardych, płytach CD/DVD lub taśmach magnetycznych). Chroni nas to jedynie na wypadek uszkodzenia urządzenia, a w żadnym stopniu nie zabezpiecza przed kradzieżą czy też innymi sytuacjami losowymi (pożar, powódź).

Możemy również wykupić taką usługę online, która za pomocą połączenia internetowego na zdalnym serwerze będzie tworzyła co jakiś czas (lub w czasie rzeczywistym) kopię zapasową danych. Są one dostępne w każdym momencie, na wypadek sytuacji losowych: kradzież, pożar, reinstalacja systemu lub uszkodzenie mechaniczne sprzętu.

Do działania w czasie rzeczywistym takie usługi potrzebują jednak bardzo dużego pasma.

Większe pasmo = nowe pomysły na usługi!

Pamiętacie jeszcze śmiałe założenie z początku rozdziału: Załóżmy więc, że pasmo nie jest dla nas ograniczeniem…?

To właśnie światłowody dają nam niemal nieograniczone pasmo i dzięki światłowodom te wszystkie usługi, które zostały wymienione (i wiele innych) już za niedługo będą mogły być dostarczone do każdego z nas!

Sieć telekomunikacyjna to ogół węzłów (systemy i urządzenia transmisyjne oraz komutacyjne), linii telekomunikacyjnych oraz łącz między węzłami, których celem jest nadawanie, odbiór lub transmisja danych, informacji lub wiadomości. Medium transmisyjnym mogą być:

- przewody miedziane,

- przewody optyczne,

- fale radiowe.

Biorąc pod uwagę zasięg, sieć można podzielić na trzy podstawowe grupy:

- WAN – sieć szkieletowa

- MAN – sieć metropolitalna

- LAN – sieć dostępowa/lokalna

Sieć WAN

(ang. Wide Area Network) jest strukturą najbardziej rozległą. Jest to sieć o zasięgu regionalnym, krajowym lub nawet międzynarodowym. Agreguje ona ruch ze wszystkich niższych segmentów sieci (MAN i LAN), stąd przepływności wymagane w pojedynczym kanale są ogromne i sięgają kilkudziesięciu/kilkuset gigabitów na sekundę (Gb/s). Ogromne znaczenie ma niezawodność sieci szkieletowej – dlatego jest ona przeważnie budowana w architekturze kratowej, aby w razie awarii zapewnić alternatywną ścieżkę transmisji.

Działa w warstwie fizycznej oraz łącza danych modelu OSI. Umożliwia wymianę ramek i pakietów pomiędzy ruterami, switchami oraz odpowiednimi sieciami LAN.

Sieć MAN

(ang. Metropolitan Area Network) – obejmuje swym zasięgiem obszar miasta, aglomeracji lub subregionu obsługując sieci dostępowe oraz centra biznesowe, gdzie niezbędna jest protekcja transmisji. Sieci MAN budowane są zwykle w oparciu o architekturę pierścienia (protekcja)

Sieć LAN

(ang. Local Area Network) – część sieci dostępowych budowana jest w oparciu o architekturę pierścienia lub kratową, aby zapewnić protekcję. Natomiast końcowe odcinki sieci dostępowych (zakończenia abonenckie) budowane są zazwyczaj w oparciu o architekturę gwiazdy, gdyż koszta zapewnienia protekcji byłyby zbyt wysokie w stosunku do wagi transmisji.

Poszczególne grupy mogą się różnić między sobą między innymi:

- techniką transmisyjną

- medium transmisyjnym

- protokołami komunikacyjnymi

- kodowaniem

Ze względu na bardzo duże przepływności w sieciach WAN i MAN najczęściej jako medium transmisyjne stosowany jest światłowód.

Dla przyłączy abonenckich, gdzie nie są wymagane tak duże przepustowości, ze względów ekonomicznych najczęściej stosuje się skrętkę nieekranowaną UTP oraz, co szczególnie popularne wśród sieci kablowych, kabel koncentryczny. Coraz większą popularność zdobywają połączenia światłowodowe bezpośrednio do domu ze względu na swoją konkurencyjną cenę, niezawodność i niemalże nieskończone pasmo.

Topologia to sposób połączenia komputerów i urządzeń w sieć. Jest to zbiór węzłów i łącz między nimi. Wybór odpowiedniej topologii sieci to jedno z pierwszych i najważniejszych zagadnień podczas projektowania sieci. Koszt sieci w bardzo dużym stopniu zależy właśnie od wyboru topologii, która z kolei determinuje:

- liczbę aktywnych i pasywnych urządzeń,

- odległość między węzłami sieci.

Rodzaje topologii fizycznych:

Magistrala/szyna

(ang. Bus) – wszystkie elementy sieci podłączone są do pojedynczej magistrali (najczęściej kabel koncentryczny 10Base-2 o maksymalnym zasięgu 185 m lub 10Base-5 do 500 m). Na obu końcach magistrali montuje się terminatory, czyli specjalne oporniki które symulują nieskończenie długi kabel eliminując tym samym odbicia sygnału, które mogłyby zakłócić transmisję do stacji końcowych.

(ang. Bus) – wszystkie elementy sieci podłączone są do pojedynczej magistrali (najczęściej kabel koncentryczny 10Base-2 o maksymalnym zasięgu 185 m lub 10Base-5 do 500 m). Na obu końcach magistrali montuje się terminatory, czyli specjalne oporniki które symulują nieskończenie długi kabel eliminując tym samym odbicia sygnału, które mogłyby zakłócić transmisję do stacji końcowych.

Sieć zbudowana w oparciu o topologię magistrali umożliwia tylko jedną transmisję o przepustowości 10 Mb/s w danym momencie. Sygnał nadany przez jedną ze stacji jest odbierany przez wszystkie, jednak interpretowany jest tylko przez stację o adresie docelowym. Bardzo łatwe jest jednak przechwycenie danych w takiej sieci.

Pierścień

(ang. Ring) – poszczególne elementy są połączone pomiędzy sobą odcinkami kabla tworząc zamknięty pierścień. Uszkodzenie jednej stacji umożliwia dalszą transmisje. Jest to ekonomiczne rozwiązanie zapewniające protekcję, często stosowane w segmencie sieci MAN.

(ang. Ring) – poszczególne elementy są połączone pomiędzy sobą odcinkami kabla tworząc zamknięty pierścień. Uszkodzenie jednej stacji umożliwia dalszą transmisje. Jest to ekonomiczne rozwiązanie zapewniające protekcję, często stosowane w segmencie sieci MAN.

Szczególnym przypadkiem jest podwójny pierścień (lub nawet poczwórny), gdzie poszczególne elementy są połączone pomiędzy sobą odcinkami tworząc dwa zamknięte pierścienie zapewniając optymalną protekcję. W pierścień mogą być zarówno podłączane komputery jak i urządzenia sieciowe (co się częściej zdarza). Jest to struktura bardzo popularna w segmencie sieci MAN.

Gwiazda

(ang. Star) – stacje (terminale) podłączone są do jednego, wspólnego punktu centralnego, w którym znajduje się koncentrator (hub) lub przełącznik (switch).

(ang. Star) – stacje (terminale) podłączone są do jednego, wspólnego punktu centralnego, w którym znajduje się koncentrator (hub) lub przełącznik (switch).

Podstawową zaletą, która wyróżnia ten typ połączenia, spośród dwóch powyższych topologii, jest to, że jeśli uszkodzeniu ulegnie dowolna ilość stacji końcowych (za wyłączeniem centrali), cała sieć nadal funkcjonuje!

Gwiazda rozszerzona

Posiada punkt centralny (podobnie do topologii gwiazdy) i punkty poboczne, które z kolei są punktami centralnymi dla kolejnych segmentów sieci.

Posiada punkt centralny (podobnie do topologii gwiazdy) i punkty poboczne, które z kolei są punktami centralnymi dla kolejnych segmentów sieci.

Punktem centralnym powinno być urządzenie o najlepszych parametrach, ponieważ będzie przetwarzało największą ilość danych.

Drzewo

Budową przypomina topologię gwiazdy rozszerzonej. Jest kombinacją topologii gwiazdy i magistrali. Patrząc od strony urządzenia centralnego, urządzenia końcowe są urządzeniemi centralnymi dla kolejnych rozgałęzień. Taki rodzaj połączenia sieci często jest stosowany w przypadku bardziej rozbudowanych sieci lokalnych, gdzie sieć, obejmuje większą liczbę stacji końcowych niż pozwala na to topologia gwiazdy. Jest jedną z najczęściej stosowanych topologii w sieciach LAN.

Budową przypomina topologię gwiazdy rozszerzonej. Jest kombinacją topologii gwiazdy i magistrali. Patrząc od strony urządzenia centralnego, urządzenia końcowe są urządzeniemi centralnymi dla kolejnych rozgałęzień. Taki rodzaj połączenia sieci często jest stosowany w przypadku bardziej rozbudowanych sieci lokalnych, gdzie sieć, obejmuje większą liczbę stacji końcowych niż pozwala na to topologia gwiazdy. Jest jedną z najczęściej stosowanych topologii w sieciach LAN.

Siatka/Struktura kratowa

(ang. Mesh) – oprócz koniecznych połączeń, sieć zawiera połączenia nadmiarowe, co w najwyższym stopniu zabezpiecza przed przerwami w dostępie do sieci. Rozwiązanie często stosowane w sieciach, w których jest wymagana wysoka bezawaryjność – czyli w sieciach szkieletowych, bądź też w centrach biznesowych. Jest to struktura bardzo popularna w segmencie sieci WAN.

(ang. Mesh) – oprócz koniecznych połączeń, sieć zawiera połączenia nadmiarowe, co w najwyższym stopniu zabezpiecza przed przerwami w dostępie do sieci. Rozwiązanie często stosowane w sieciach, w których jest wymagana wysoka bezawaryjność – czyli w sieciach szkieletowych, bądź też w centrach biznesowych. Jest to struktura bardzo popularna w segmencie sieci WAN.

Szczególnym przykładem struktury oczkowej jest siatka – czyli połączenie węzłów każdy z każdym.

Protokoły i obsługiwany przez nie ruch w sieci mogą mieć zarówno charakter połączeniowy jak i bezpołączeniowy.

Bezpołączeniowy tryb przesyłu danych

Przed wysłaniem dane dzielone są na pakiety i każdy z pakietów danych może być wysłany do stacji docelowej inną drogą niż pakiet poprzedni lub następny. Dzięki temu w razie wystąpienia błędu w transmisji, tylko część pakietów jest tracona i trasa szybko może być rekonfigurowana w razie błędu oczywiście omijając uszkodzone miejsce w sieci. Efektem ubocznym, jest to, że poszczególne porcje informacji biegnąć różnymi ścieżkami, mogą docierać do stacji docelowej w nieodpowiedniej kolejności. Stąd potrzeba stosowania mechanizmów kontrolnych, co łączy się ze zwiększonym opóźnieniem.

Najlepiej znanym przykładem sieci bezpołączeniowej jest protokół IP.

Połączeniowy tryb przesyłu danych

Na początku transmisji ustanawiana jest trasa/ścieżka między źródłem, a stacją docelową i funkcjonuje ona jedynie na czas trwania tej transmisji, dlatego otrzymane dane uporządkowane są w odpowiedniej kolejności. Dzięki rezerwacji zasobów na czas połączenia, możemy gwarantować pewną jakość transmisji i usług (QoS), ale z drugiej strony marnujemy przy tym część łącza.

Wyróżniamy trzy fazy połączenia:

- nawiązanie połączenia,

- transmisja danych,

- rozłączanie połączenia.

Ten rodzaj połączeń stosuje się tam, gdzie musimy zagwarantować pewien poziom jakości usług (głównie zmienność opóźnienia). Połączeniowa metoda przesyłu danych stosowana jest między innymi w Frame Relay i w wypierającym go ATM’ie.

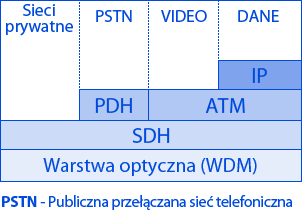

Struktura sieci i protokołów

Biorąc pod uwagę sieć w sensie globalnym (LAN + MAN + WAN) struktura sieci, ze względu na istniejącą infrastrukturę, bardzo często przyjmuje strukturę jak na schemacie po lewej. W sieciach lokalnych do przesyłania danych najczęściej służy protokół IP który w segmencie MAN jest często agregowany w protokole ATM, który z kolei korzysta z istniejącej infrastruktury i urządzeń SDH, które w segmencie WAN przesyłane są za pomocą urządzeń optycznych ze zwielokrotnianiem w dziedzinie długości fali. Do przesyłania obrazów video i innych usług wymagających odpowiedniego poziomu QoS używamy najczęściej protokołu ATM (warstwy poniżej analogicznie jak w przypadku przesyłania danych) itd.

Biorąc pod uwagę sieć w sensie globalnym (LAN + MAN + WAN) struktura sieci, ze względu na istniejącą infrastrukturę, bardzo często przyjmuje strukturę jak na schemacie po lewej. W sieciach lokalnych do przesyłania danych najczęściej służy protokół IP który w segmencie MAN jest często agregowany w protokole ATM, który z kolei korzysta z istniejącej infrastruktury i urządzeń SDH, które w segmencie WAN przesyłane są za pomocą urządzeń optycznych ze zwielokrotnianiem w dziedzinie długości fali. Do przesyłania obrazów video i innych usług wymagających odpowiedniego poziomu QoS używamy najczęściej protokołu ATM (warstwy poniżej analogicznie jak w przypadku przesyłania danych) itd.

Dzięki wprowadzeniu technik o wysokich przepływnościach: 10 gigabitowy ethernet oraz PON można zrezygnować z warstw pośredniczących (ATM, SDH), przyspieszając i upraszczając trasmisję danych.

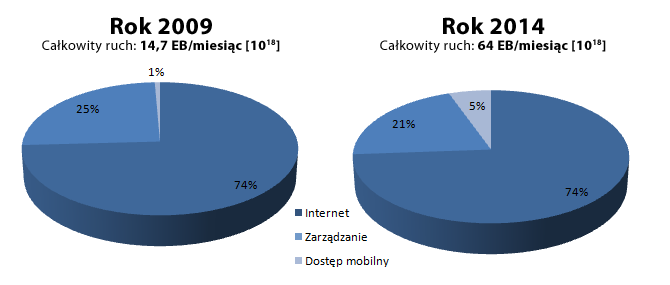

Na podstawie raportów wydawanych przez Cisco Visual Networking Index poniżej znajduje się kilka wykresów przedstawiających ruch w internecie. Wykresy zawierają dane z 2009 i części 2010 roku oraz przewidywania na kolejne lata. Szacuje się, że ruch generowany przez urządzenia sieciowe oraz urządzenia końcowe przyrasta rok do roku o około 40% i ten trend jest utrzymywany od kilku lat.

Jak zatem rozkłada się ruch w internecie?

źródło: Cisco, VNI, 2010

- Internet – to ogólnie pojęty ruch IP,

- Zarządzanie – ruch generowany zarówno przez urządzenia w sieci jak i ruch operatorski,

- Dostęp mobilny – ruch generowany przez smartfony oraz laptopy (dostępu mobilnego nie należy mylić z siecią bezprzewodową).

Przewiduje się, że ruch w latach 2009 i 2014 wzrośnie ponad czterokrotnie. Zarówno ruch w internecie jak i ruch związany z zarządzaniem sieci będzie rósł w porównywalnym tempie, czego nie można powiedzieć o ruchu generowanym przez urządzenia mobilne. Będzie on rósł lawinowo, co spowodowane jest między innymi tym, że urządzenia przenośne typu smartfon mają coraz większe możliwości oraz tego, że zasięg i dostęp do sieci komórkowych mamy niemal wszędzie.

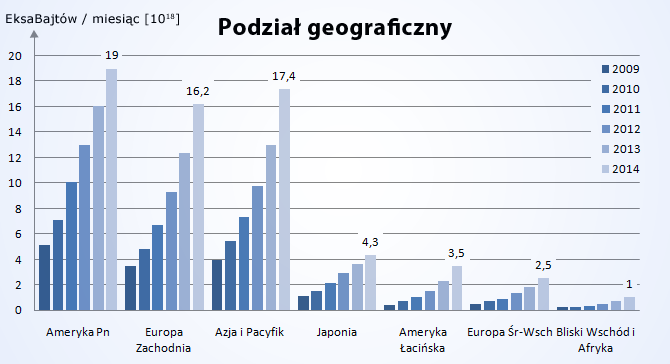

Na kolejnych wykresach przedstawione będą przewidywania roczne na przestrzeni lat 2009 – 2014. Zacznijmy więc od podziału ruchu w internecie ze względu na obszar:

źródło: Cisco, VNI, 2010

Analizując dane ciężko wyłonić region w którym generowany ruch będzie przyrastał najszybciej. Przewiduje się, że bez względu na miejsce zamieszkania będzie on stale przyrastał o około 40% rok do roku.

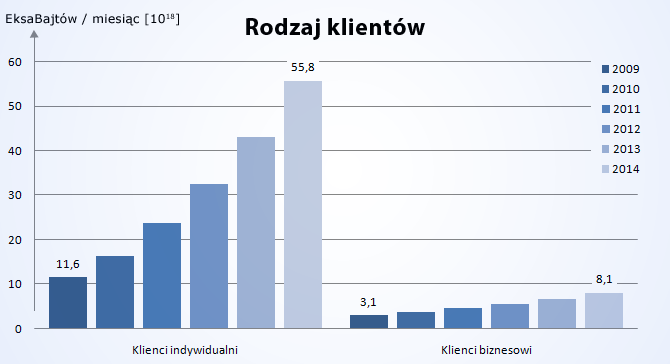

Kolejny wykres przedstawia podział na klientów indywidualnych i biznesowych:

źródło: Cisco, VNI, 2010

- Klienci indywidualni – ruch generowany przez gospodarstwa domowe, uniwersytety wraz z przynależącymi akademikami, kafejki internetowe,

- Klienci biznesowi – ogół ruchu generowanego przez firmy, instytucje, urzędy oraz ruch operatorski.

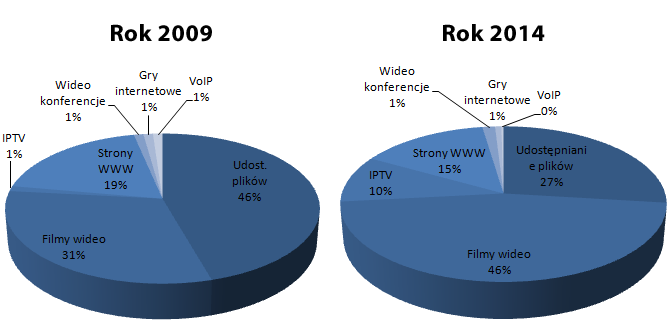

Kolejny wykres to dane historyczne (2009) i przewidywania na rok 2014 pokazujące co w największym stopniu generuje ruch w internecie:

źródło: Cisco, VNI, 2010

- Udostępnianie plików – ruch zarówno P2P (BitTorrent, eDonkey itp) jak i serwisów hostujących pliki (rapidshare, megaupload itp)

- Filmy wideo – streaming filmów wideo zarówno płatnych jak i bezpłatnych oglądanych na komputerze

- IPTV – telewizja oraz VOD w telewizorze podłączonym do internetu

- Strony WWW – Ogół ruchu generowanego podczas przeglądania stron internetowych, czytania maili, używania komunikatorów itp, za wyjątkiem serwisów hostujących pliki i serwisów wideo

- Wideo konferencje – wideokonferencje, czaty z kamerkami, serwisy www udostępniające obraz z kamer

- Gry internetowe – małe interaktywne gry, gry planszowe i karciane umożliwiającymi rywalizację z innymi graczami, gry komputerowe w trybie multiplayer.

- VoIP

Wykresy przedstawiają obecną tendencję – coraz rzadziej korzystamy z sieci Peer to Peer a w coraz większym stopniu z serwisów typu youtube, vimeo itp.

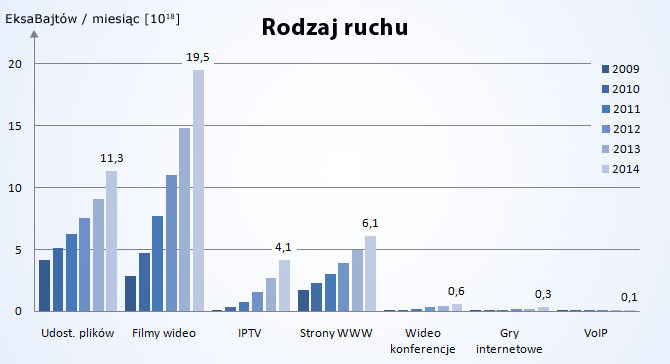

Kolejny wykres przedstawia te same dane co powyżej, rozbite na poszczególne usługi i przyrost generowanego przez nie ruchu w nadchodzących latach:

źródło: Cisco, VNI, 2010

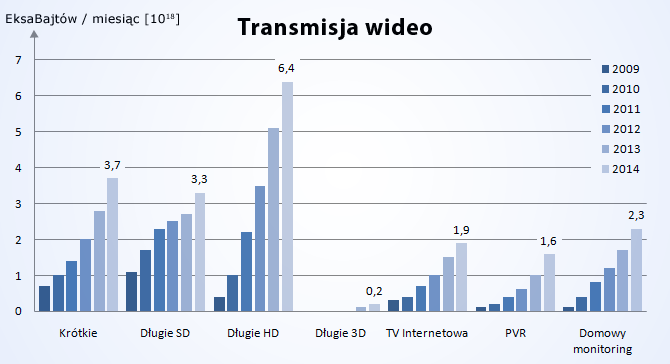

W związku z najbardziej dynamicznym wzrostem ruchu generowanego przez ogólnie pojęte strumieniowanie wideo przyjrzyjmy się mu bliżej:

źródło: Cisco, VNI, 2010

- Krótkie filmiki – filmiki nakręcone przez użytkowników i klipy, nie dłuższe niż 7 minut

- Długie SD – klipy i filmy dłuższe niż 7 minut w standardowej jakość

- Długie HD

- Długie 3D – powoli wprowadzane, długie filmy w jakości 3D

- TV Internetowa – ruch generowany przez zarówno programy do odbierania TV jak i aplety na stronach internetowych

- PVR – nagrane transmisje telewizyjne dla późniejszego obejrzenia

- Domowy monitoring – zarówno nagrania jak i strumieniowanie na żywo obrazu z kamer monitoringu domowego

Ciekawostki

- Szacuje się, że obejrzenie wszystkich materiałów wideo oglądanych przez internautów na całym świecie w ciągu sekundy zajęłoby jednej osobie około 2 lata.

- Pod koniec roku 2010 ruch generowany przez strumieniowanie oraz pobieranie z serwisów hostujących pliki filmów wideo przewyższy ruch generowany przez sieci P2P.

- W roku 2014 ruch generowany przez użytkowników w ciągu miesiąca, będzie można zapisać na około 12 miliardach płyt DVD.

- W 2014 roku prawie 66% ruchu mobilnego będzie generowanego przez filmiki wideo.

- Ruch generowany przez klientów biznesowych rośnie rok do roku około dwa razy wolniej (ok. 20%) niż generowany przez klientów indywidualnych (40%)

7. Dostęp do internetu w Polsce

Coraz chętniej korzystamy z internetu i praktycznie bez względu na wiek, każda grupa może znaleźć w sieci treści skierowane do niej. Dzieje się tak głównie ze względu na coraz lepszą dostępność oraz cenę dostępu do sieci. W tym rozdziale zajmiemy się analizą cen oraz konkurencyjności polskiego rynku dostępu do internetu w stosunku do reszty Europy na podstawie raportu UKE.

Przyjrzyjmy się więc dynamice wzrostu wartości rynku dostępu do internetu w Polsce:

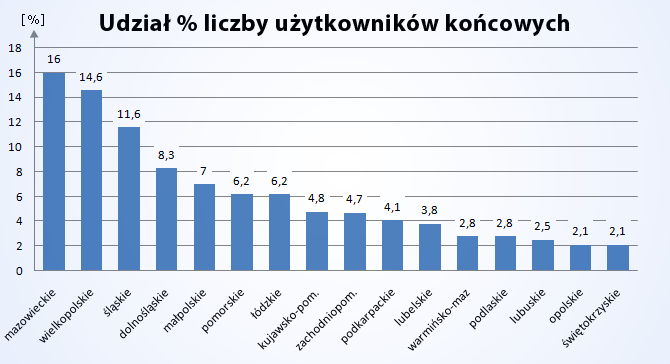

Jak prezentuje się rynek dostępu do sieci w zależności od regionu?

Rozkład liczby abonentów w zależności od województwa jest bardzo zróżnicowany. Dzieje się tak z kilku powodów:

- istniejąca infrastruktura – zwykle lepiej rozwinięta w okolicach miast niż na peryferiach i na wsi

- różnice w zaludnieniu

- gęstość i rozmieszczenie dużych miast – duże miasta charakteryzują się wysokim nasyceniem usług oraz potencjalnych abonentów i tam też jest największa konkurencyjność ze strony dostawców internetu. Nic więc dziwnego, że są tam oferowane najniższe ceny za dostęp do sieci szerokopasmowej co przekłada się na ogromną liczbę abonentów. Abonentów kusi się pakietami usług, gdzie nierzadko dostaje się jedną z usług (telewizja, telefon i internet) za darmo.

Przyjrzyjmy się zatem szczegółowo jakie są dysproporcje w dostępie do szerokopasmowego internetu w zależności od regionu:

Polska na tle innych krajów

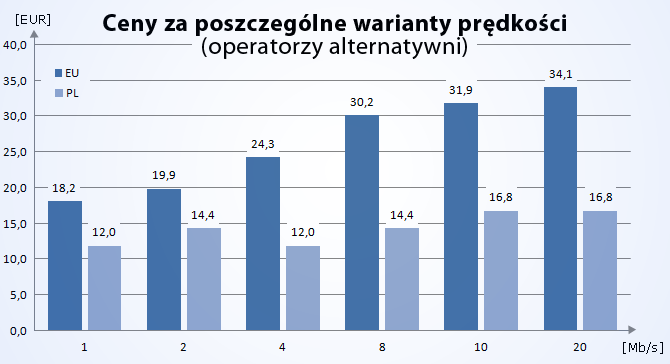

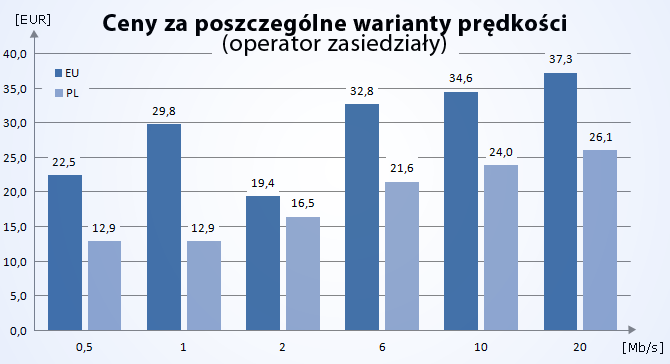

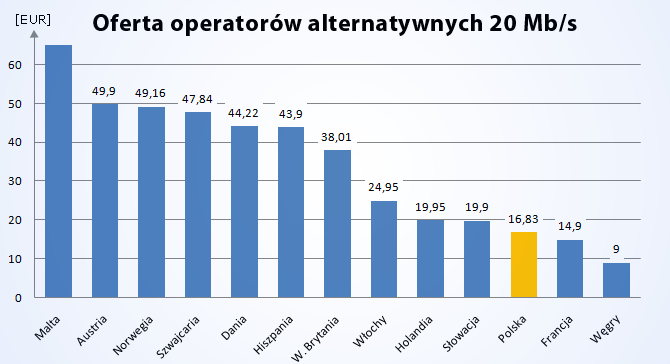

Wykresy w tym rozdziale zostały sporządzone na podstawie raportu UKE na temat rynku telekomunikacyjnego w Polsce oraz na podstawie analizy cen dostępu do internetu w roku 2009. Z raportów wynika, co może być zaskakujące, że internet w Polsce jest tani. Ceny oferowane przez dostawców internetu w Polsce są znacznie niższe niż średnia europejska. W zależności od oferowanej przepustowości: od kilkunastu do nawet 50%. Przyjrzyjmy się więc wykresom ceny za określone przepustowości w przypadku operatorów alternatywnych oraz operatora dominującego (zasiedziałego) w odniesieniu do średniej europejskiej.

Jak widać ceny operatorów alternatywnych są znacznie niższe i bardziej konkurencyjne niż ceny operatora dominującego, a przegrywają one z operatorem dominującym tylko w przypadku najniższych przepływności: 512 kb/s oraz 1 Mb/s. Większość naszych sąsiadów zrezygnowała jednak z tak niskich przepustowości i minimalne łącza oferowane przez dostawców w Europie to 2 Mb/s. Tylko 4 kraje w całej Europie oferują tak niską przepustowość: 1 Mb/s. Co gorsza w Polsce najpopularniejsze są właśnie najwolniejsze łącza – do 2 Mb/s – stanowią one 60% rynku! W roku 2008 było to aż 80%.

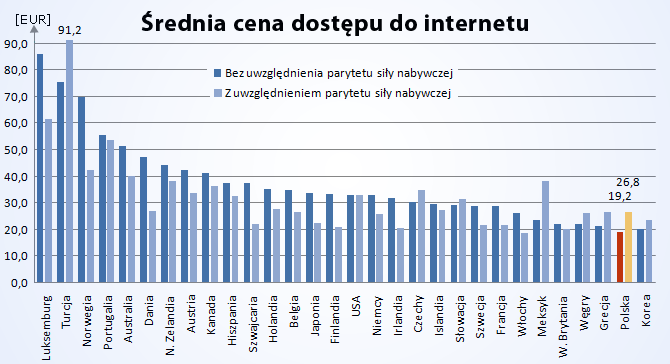

Przyjrzyjmy się jak Polska wypada na tle poszczególnych państw (nie tylko europejskich):

Co również może wydawać się zaskakujące Polska wypada bardzo korzystnie na tle innych Państw. Bez uwzględnienia parytetu siły nabywczej Polacy zajmują przedostatnią pozycję ze średnią ceną dostępu do internetu na poziomie około 20 Euro podczas gdy w Luksemburgu średnia wyniosła około 86 Euro. Uwzględniając parytet siły nabywczej pieniądza Polska plasuje się w połowie stawki.

Na koniec, wykres najszybszych oferowanych łącz przez operatorów telekomunikacyjnych – 20 Mb/s. Przepustowości powyżej 20 Mb/s były oferowane w trakcie sporządzania raportu (2009), jednak były to oferty sieci kablowych, a nie operatorów telekomunikacyjnych.

Ciekawostka: ADSL/ADSL2 oferuje przepływności do 24 Mb/s, dlatego też te właśnie techniki są najbardziej popularne w Polsce.

Połączenie komputera z Internetem możliwe jest przez wykorzystanie którejś z technik, która pozwala na komunikację z najbliższą bramką (gateway), która posiada połączenie z innymi systemami w Internecie. Wykorzystują one do tego celu, linie telefoniczne (modemy, ISDN, ADSL), inne sieci przewodowe (transmisja przez sieć światłowdową, telewizję kablową, sieci energetyczne) oraz bezprzewodowe (GPRS, WiFi i WiMAX oraz łącza satelitarne).

Kabel symetryczny – skrętka

(ang. twisted-pair cable) – rodzaj kabla służącego do przesyłania informacji zbudowany z jednej lub więcej par skręconych ze sobą przewodów miedzianych i jest najczęściej stosowanym medium transmisyjnym w telefonii analogowej, sieci Ethernet, kamerach IP itp. Każda z par posiada inną długość skręcenia co obniża przeniki elektromagnetyczne, ale niestety również zawęża pasmo. Samo skręcanie przewodów nie eliminuje jednak całkowicie przesłuchów, ponieważ gdy obok siebie położonych jest wiele kabli, łatwo o przypadek, że niektóre przewody w różnych kablach mają ten sam stopień skręcenia co skutkuje przesłuchami. By jeszcze bardziej zminimalizować ten efekt, stosuje się ekranowanie przewodów za pomocą metalowej siatki bądź folii.

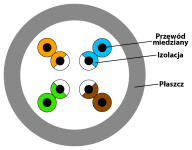

• Skrętka nieekranowana UTP

Skrętka nieekranowana – UTP (rysunek po lewej) jest najczęściej stosowanym rodzajem kabla w dzisiejszym Ethernecie i telefonii analogowej ze względu na swój niski koszt. Pomimo skręcenia przewodów kabel jest jednak nadal podatny na przeniki, dlatego też warto stosować droższe kable z metalowym ekranem. Najprostszym rodzajem kabla, gdzie ekranowany jest cały przewód jest S-UTP (rysunek po prawej). Nie jest on jednak tak efektywny jak kabel z ekranowaniem każdej pary przewodów z osobna (STP).

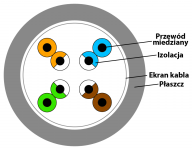

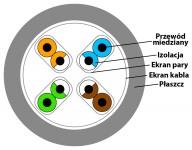

• Skrętka ekranowana STP

Za pomocą metalowej siatki można ekranować każdą parę przewodów. Przykładem jest STP (rysunek po lewej), co zmniejsza przeniki elektromagnetyczne. Dodatkowo można stosować ekran metalowy na cały przewód – S-STP (prawa). Ważne, aby ekran był dobrze uziemiony na końcach odcinków linii. Źle uziemiony ekran działa jak antena i pogarsza tym samym parametry sygnału. Czasem stosuje się również ekran w postaci folii (FTP).

Kabel współosiowy – koncentryk

(ang. Coaxial cable) rodzaj kabla służącego do transmisji danych. Patrząc na budowę kabla od środka, mamy przewód transmisyjny miedziany (kable inne niż miedziane zostały wyparte z rynku), wokół niego mamy izolację dielektryczną, następnie oplot (aluminiowy lub miedziany) i izolację zewnętrzną. Dzięki temu, że wszystkie te warstwy leżą na wspólnej osi (stąd nazwa współosiowy/koncentryk), oraz że przewód transmisyjny znajduje się „wewnątrz” ekranu – minimalizowany jest wpływ przeników elektromagnetycznych.

(ang. Coaxial cable) rodzaj kabla służącego do transmisji danych. Patrząc na budowę kabla od środka, mamy przewód transmisyjny miedziany (kable inne niż miedziane zostały wyparte z rynku), wokół niego mamy izolację dielektryczną, następnie oplot (aluminiowy lub miedziany) i izolację zewnętrzną. Dzięki temu, że wszystkie te warstwy leżą na wspólnej osi (stąd nazwa współosiowy/koncentryk), oraz że przewód transmisyjny znajduje się „wewnątrz” ekranu – minimalizowany jest wpływ przeników elektromagnetycznych.

Kabel światłowodowy

Włókno światłowodowe to przewód szklany lub plastikowy o przekroju okrągłym. Nie jest on jednak tworem materiałowo jednorodnym. Jego rdzeń jest otoczony płaszczem o innej gęstości optycznej, a co za tym idzie, o innym współczynniku załamania światła. Współczynnik załamania w rdzeniu jest wyższy niż w płaszczu, co sprawia, że dzięki zjawisku całkowitego wewnętrznego odbicia promień świetlny przemieszcza się cały czas w rdzeniu, odbijając się na granicy ośrodków o różnej gęstości.

Włókno światłowodowe to przewód szklany lub plastikowy o przekroju okrągłym. Nie jest on jednak tworem materiałowo jednorodnym. Jego rdzeń jest otoczony płaszczem o innej gęstości optycznej, a co za tym idzie, o innym współczynniku załamania światła. Współczynnik załamania w rdzeniu jest wyższy niż w płaszczu, co sprawia, że dzięki zjawisku całkowitego wewnętrznego odbicia promień świetlny przemieszcza się cały czas w rdzeniu, odbijając się na granicy ośrodków o różnej gęstości.

• Włókna jednomodowe

(ang. Single-mode – SM) mają rdzeń o średnicy 9 µm, transmitują jeden mod sygnału optycznego i dają możliwość uzyskania dużych zasięgów transmisji. Dlatego ten typ włókien jest dziś podstawowym medium używanym w telekomunikacji – zarówno do budowy sieci szkieletowych, jak i sieci dostępu abonenckiego.

(ang. Single-mode – SM) mają rdzeń o średnicy 9 µm, transmitują jeden mod sygnału optycznego i dają możliwość uzyskania dużych zasięgów transmisji. Dlatego ten typ włókien jest dziś podstawowym medium używanym w telekomunikacji – zarówno do budowy sieci szkieletowych, jak i sieci dostępu abonenckiego.

• Włókna wielomodowe

(ang. Multimode – MM) są wykonane ze szkła kwarcowego. Ze względu na fakt, iż transmitują wiele składowych sygnału optycznego (mody), mają zasięg ograniczony do kilku kilometrów i są używane w lokalnych sieciach komputerowych LAN.

(ang. Multimode – MM) są wykonane ze szkła kwarcowego. Ze względu na fakt, iż transmitują wiele składowych sygnału optycznego (mody), mają zasięg ograniczony do kilku kilometrów i są używane w lokalnych sieciach komputerowych LAN.

Nieosłonięte włókno ze szkła kwarcowego o średnicy 125 µm byłoby jednak bezużyteczne w praktycznych zastosowaniach ze względu na delikatność i kruchość materiału, z którego jest wykonane. Dlatego już w fabryce, w której produkuje się włókna metodą wyciągania na gorąco z tzw. preformy szklanej, pokrywa się je odpowiednią powłoką zabezpieczającą mechanicznie i nadającą elastyczność. Taka powłoka, najczęściej akrylowa o średnicy 250 µm, nazywana jest pokryciem pierwotnym. Dopiero taki „surowiec” staje się elementem do produkcji kabli światłowodowych. Obok włókien ze szkła kwarcowego istnieją także włókna plastikowe. Są one stosowane do łączenia urządzeń automatyki przemysłowej, aparatury medycznej lub sprzętu Hi-Fi na bardzo krótkich odcinkach.

Sieci bezprzewodowe

Sieci bezprzewodowe (radiowe) wydają się ciekawą alternatywą dla sieci przewodowych – przede wszystkim dlatego, że cechują się relatywnie niższym kosztem inwestycji, wynikającym z najniższych kosztów budowy infrastruktury transmisyjnej. Mówiąc wprost – nie trzeba kopać setek kilometrów tras kablowych.

Sieci bezprzewodowe (radiowe) wydają się ciekawą alternatywą dla sieci przewodowych – przede wszystkim dlatego, że cechują się relatywnie niższym kosztem inwestycji, wynikającym z najniższych kosztów budowy infrastruktury transmisyjnej. Mówiąc wprost – nie trzeba kopać setek kilometrów tras kablowych.

Standardami szerokopasmowych bezprzewodowych sieci dostępowych stosowanymi dzisiaj są:

• WiMAX (IEEE 802.16) – charakteryzuje się użytecznym zasięgiem ok. 5 km i przepływnościmi do 70 Mb/s.

• WiFi (IEEE 802.11) – jest bardziej dojrzałą techniką, lepiej zestandaryzowaną, lecz jego zakres użyteczny wynosi jedynie 100 m przy przepływności rzędu 300 Mb/s. Problemem sieci WiFi jest duża podatność na zakłócenia i spadek wydajności przy dużej liczbie równocześnie przyłączonych użytkowników. Pomimo tych ograniczeń za sprawą dojrzałości standardu WiFi jest obecnie powszechniej używane w sieciach dostępowych niż WiMAX.

• 3G/4G – W związku z rozwojem sieci telefonii komórkowej, łączność 3G to obecnie nie tylko połączenia pozwalające na korzystanie z internetu na ekranie telefonu komórkowego, ale również (co staje się coraz bardziej popularne) jako połączenia do laptopów. Dużym ograniczeniem jest oferowane pasmo – teoretycznie do 21 Mb/s. W praktyce w Polsce przepływności dochodzą maksymalnie do 4 Mb/s. Na szczęście telefonia komórkowa rozwija się i planowane są już sieci czwartej generacji w specyfikacji LTE oferujące do 150 Mb/s w kierunku do abonenta w wartości szczytowej, 5–50 Mb/s w realnych warunkach.

Z jednej strony, niezaprzeczalną zaletą sieci bezprzewodowych jest mobilność. Wielu użytkowników stawia tę cechę wyżej niż multimedialność i wysoką jakość oferowanych usług. Systemy radiowe mogą również dotrzeć do użytkowników na obszarach, gdzie dostęp kablowy jest utrudniony bądź ekonomicznie nieuzasadniony. Dodatkowo początkowy koszt inwestycji jest niski i nie odstrasza inwestorów.

Z drugiej zaś strony, systemy radiowe mają nieduży zasięg, oraz co nie występuje w sieciach kablowych, zakłócenia związane z warunkami atmosferycznymi, ograniczenia zasięgu na obszarach o gęstej zabudowie oraz w terenach górzystych i zalesionych. Głównym minusem sieci bezprzewodowych są opóźnienia transmisji, które nie pozwalają na świadczenie usług na takim poziomie by można je uznawać za rozwiązania dostępu do internetu/telewizji w domu. Trzeba w końcu zauważyć, że wspomniane na początku „relatywnie niskie koszty inwestycji” w dłuższej perspektywie nie są już tak bardzo niskie. Cechą charakterystyczną systemów radiowych jest ich ciągła ewolucja powiązana z częstymi inwestycjami.

Systemy bezprzewodowe należy rozpatrywać raczej w kategorii uzupełnienia dla sieci kablowych, a nie jako rozwiązanie konkurencyjne.

• Free Space Optics

Jako ciekawostkę można również wziąć pod uwagę Free Space Optics, jako technikę bezprzewodowej komunikacji optycznej, wykorzystującą emisję światła do przesyłania danych pomiędzy dwoma punktami w powietrzu. Technika ta oferuje wysokie przepływności (nawet powyżej 1 Gb/s) i bezpieczeństwo transmisji (dzięki czemu znajduje zastosowanie w wojsku).

Jako ciekawostkę można również wziąć pod uwagę Free Space Optics, jako technikę bezprzewodowej komunikacji optycznej, wykorzystującą emisję światła do przesyłania danych pomiędzy dwoma punktami w powietrzu. Technika ta oferuje wysokie przepływności (nawet powyżej 1 Gb/s) i bezpieczeństwo transmisji (dzięki czemu znajduje zastosowanie w wojsku).

Łącza FSO są jeszcze bardziej wrażliwe na warunki atmosferyczne niż Wifi i WiMAX – maksymalny teoretyczny zasięg to 10 km, jednak jakiekolwiek opady lub mgła mogą uniemożliwić całkowicie transmisję nawet dla obiektów oddalonych od siebie o kilkaset metrów. Mgła wprowadza tłumienność nawet do 350 dB/km, przez co FSO nie bierze się w ogóle pod uwagę jako łącze „na dłuższą metę”.

Kable energetyczne

Linii energetyczne wykorzystywane są do przesyłania danych już od dawna. Przykładem są systemy monitorujące stan sieci oraz do zarządzania mocą. Ułatwia to kontrolowanie oraz błyskawiczne działanie na wypadek awarii. Skoro da się wysyłać informacje przez linie energetyczne to czy da się je wykorzystać jako medium transmisyjne w sieciach szerokopasmowych?

Odpowiedź jest zaskakująca. TAK. Co więcej istnieją już gotowe systemy nawet na Polskim rynku.

9. Techniki dostępu do sieci i operatorzy

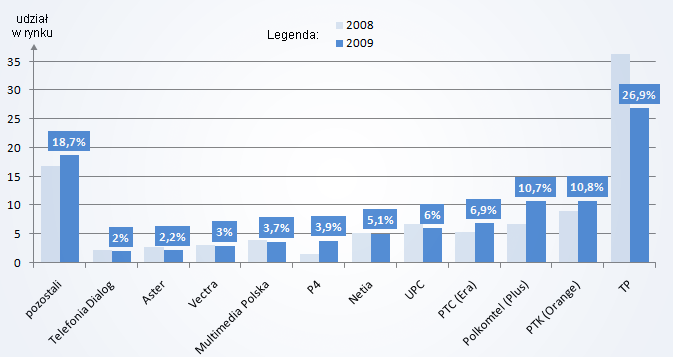

Techniki informacyjne i telekomunikacyjne (ICT) coraz szybciej zyskują na wartości w Polsce. Sam rynek dostępu do internetu szacowany jest w Polsce na około 4 miliardy złotych. Jest to duży kawałek tortu do podziału i między innymi dzięki odpowiednim regulacjom, działaniom UKE, dofinansowaniom z unii, a przede wszystkim dzięki rozwojowi techniki i technologii, wzrostowi potrzeb ludzi na dostęp do internetu w ostatnich latach zauważamy znaczącą poprawę jakości łącz, wzrost oferowanych przepustowości oraz coraz to nowe usługi.

Poniższy wykres przedstawia najbardziej liczących się graczy na Polskim rynku:

źródło: UKE

Poniżej przedstawione zostały podstawowe techniki szerokopasmowego dostępu do internetu oraz telewizji w Polsce:

Operatorzy telekomunikacyjni

Operatorzy telekomunikacyjni są w stanie zapewnić dostęp do sieci szerokopasmowej zarówno w dużych aglomeracjach jak i małych miasteczkach. Należy również do nich większość sieci szkieletowych, dających dostęp do sieci każdego rodzaju: sieciom kablowym, mobilnym, dostawcom ISP przez co są jednym z najważniejszych ogniw obecnych sieci szerokopasmowych. Klientom instytucjonalym są w stanie zapewnić usługi o odpowiednim poziomie jakości (QoS) za odpowiednio wyższą cenę. Tworzą również wewnętrzne (intranetowe) sieci dla dużych korporacji.

Operatorzy telekomunikacyjni głównie są dostawcami internetu i telefonii. Nie są może tak elastyczni jak operatorzy telewizji kablowych, ale również wprowadzają kolejne usługi i kuszą klientów różnymi promocjami. Co jest charakterystyczne zarówno dla operatorów telekomunikacyjnych jak i telewizji kablowych: biorąc pakiet 3 usług (ang. Triple play: internet, telewizja i telefon) często jedną z usług (najtańszą) otrzymujemy za darmo, co prócz oszczędności daje nam dodatkową korzyść w postaci jednego rachunku.

Najwięksi operatorzy: TPSA (operator dominujący), Netia, Dialog…

Operatorzy telewizji kablowych CATV

Operatorzy sieci telewizji kablowych, skupieni głównie w dużych aglomeracjach, dysponują dostępem do pętli lokalnej i co za tym idzie wielkiej rzeszy klientów, którzy bardzo chętnie wykupują nowe usługi. Już w tym momencie są dostawcami mediów informacyjnych i rozrywkowych w postaci: telewizji, internetu, VoD jak i wielu innych. Klientom biznesowym oferują dodatkowo zaawansowane usługi telefoniczne i informacyjne. W przeciwieństwie do operatorów telekomunikacyjnych, są bardzo elastyczni i w zależności od popytu, szybko wprowadzają nowe usługi. Przypomnijmy, że jeszcze do niedawna, operatorzy sieci kablowych, jak sama nazwa wskazuje, dostarczali tylko telewizję.

Najwięksi operatorzy: UPC, Vectra, Aster.

Operatorzy mobilni

Największą zaletą mobilnego dostępu do internetu jest to, że dostęp do sieci mamy praktycznie wszędzie, a dokładniej tam, gdzie jesteśmy w zasięgu sieci operatorów komórkowych. Obecnie np. w zasięgu sieci Orange znajduje się ponad 99% mieszkanców Polski. Kolejną zaletą jest to, że internet mobilny to nie tylko internet w telefonie, ale dzięki modemom USB dostarcza internet również do laptopów, netbooków ale i komputerów stacjonarnych.

Największą wadą jest jednak oferowane pasmo – teoretycznie do 21 Mb/s. W praktyce, w Polsce przepływności dochodzą do 2 Mb/s w centrum największych miast.

Najwięksi operatorzy: Orange, Plus, Era, Play ale również alternatywni, korzystający z infrastruktury operatorów komórkowych.

Sieć szerokopasmowa to nie tylko dostęp do internetu ale również do telewizji. Oczywistym dostawcą sygnału telewizyjnego i zarazem najbardziej popularnym w Polsce są operatorzy telewizji kablowych. Dostarczają oni sygnał telewizyjny (zarówno analogowy jak i cyfrowy) do większości mieszkań w miastach. Ale co z małymi miasteczkami i wsiami? Warto więc wspomnieć o alternatywnych technikach dostępu do samej telewizji:

Operatorzy DVB-S

(ang. Digital Video Broadcasting – Satellite) – jest standardem cyfrowej telewizji, transmitowanej przez nadajniki (transpondery) umieszczone na sztucznych satelitach Ziemi. Dla Polski, najpopularniejszymi pozycjami satelitarnymi są: Hotbird (13E) i Astra (19,2E). Wraz z rozwojem telewizji satelitarnej sygnał analogowy nadawany przez transpondery niemal został obecnie całkowicie wyparty przez systemy cyfrowe. Dzięki kompresji obrazu (MPEG-2 i MPEG-4), można oferować coraz więcej i w coraz lepszej jakości kanały.

(ang. Digital Video Broadcasting – Satellite) – jest standardem cyfrowej telewizji, transmitowanej przez nadajniki (transpondery) umieszczone na sztucznych satelitach Ziemi. Dla Polski, najpopularniejszymi pozycjami satelitarnymi są: Hotbird (13E) i Astra (19,2E). Wraz z rozwojem telewizji satelitarnej sygnał analogowy nadawany przez transpondery niemal został obecnie całkowicie wyparty przez systemy cyfrowe. Dzięki kompresji obrazu (MPEG-2 i MPEG-4), można oferować coraz więcej i w coraz lepszej jakości kanały.

Główni operatorzy satelitarni w Polsce to:

• Cyfra+

• Cyfrowy Polsat

• telewizja N

Naziemna telewizja DVB-T

Telewizja naziemna jak sama nazwa wskazuje, wykorzystuje do emisji programów telewizyjnych nadajniki znajdujące się na powierzchni Ziemi.

Telewizja naziemna jak sama nazwa wskazuje, wykorzystuje do emisji programów telewizyjnych nadajniki znajdujące się na powierzchni Ziemi.

Jest to często stosowana technika dostępu do telewizji w Europie. Początkowo transmitowane programy były w postaci analogowej. Wraz z rozwojem techniki (kompresja obrazu) zaczęto stosować sygnał cyfrowy. Pod tym względem Polska na tle innych państw Europy wygląda delikatnie mówiąc – słabo. Daty rozpoczęcia regularnych emisji cyfrowych są stale przesuwane i jak do tej pory nie mamy uruchomionego żadnego cyfrowego nadajnika DVB-T.

17 marca 2015 nastąpi ostateczne zaniechanie ochrony przed zakłóceniami telewizji analogowej – czyli wyłączenie sygnału analogowego dla telewizji naziemnej.

Źródło: polskaszerokopasmowa.pl/szerokopasmowi.pl/opr. własne